Chris Goward van WiderFunnel vertelt in zijn boek You Should Test That exact wat hij vindt van usability testing wanneer het gaat om conversie optimalisatie.

Nearly as bad as best-practice consulting or using the pre & post method is to put too much trust in individual user testing. I define user testing as an excersise where you observe a small group or a single user attempting to accomplish a predefined task on your website. User testing can be an important method for generating hypotheses; but used alone, it isn’t conversion optimization. Don’t make the mistake of following the findings from user testing without verifying using controlled A/B/n tests.

Hij zegt eigenlijk dat je niet te veel vertrouwen moet hebben in usability testing, omdat het een oefening met maar een of meerdere mensen is. Het kan een goede manier zijn om achter hypotheses te komen, maar wanneer je de uitkomst zonder gecontroleerde A/B/n-test volgt, is dit geen conversie optimalisatie.

Ik ben het niet helemaal met hem eens. Mijn redenering staat hieronder beschreven. Wat is jouw mening? Discussieer en leer mee.

Usability testing & Don’t Make Me Think

Jaren geleden begon ik mijn literatuurstudie met Steve Krugs Don’t Make Me Think. Een geweldig boek en voor mij in die tijd een echte eyeopener. Voor de mensen die het boek niet kennen: het gaat over hoe jij je website gebruiksvriendelijker kunt maken met als doel dat je de bezoeker niet meer laat nadenken (dit doet hij namelijk niet graag).

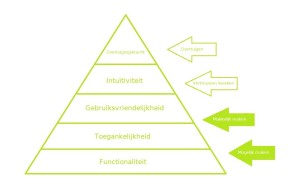

Usability speelt zich vooral af in de onderste twee lagen van het conversie optimalisatie model: functionaliteit (het mogelijk maken) en toegankelijkheid (het makkelijk maken). Bij usability testing ga je in mijn ogen dan ook vooral op zoek naar de struikelblokken. Welke handelingen zijn moeilijk te vinden en daarmee uit te voeren? Weet iemand direct wat hij moet doen op een pagina? Is het makkelijk om een aankoop te doen?

Er zijn vele discussies geweest over het aantal deelnemers bij zo’n test, de bijbehorende geloofwaardigheid en de aannames die je wellicht doet. Een voorbeeld van Steve Krug vond ik echt briljant. Je gaat testen of iemand het kantoor goed kan bereiken en je ziet de eerste deelnemer van de test vallen over een stuk losliggend vloerkleed, daarna de tweede deelnemer en precies hetzelfde gebeurt bij de derde deelnemer. Dan kun je er gewoon van uitgaan dat dit een struikelblok is voor veel mensen (de vierde, vijfde of de honderdste deelnemer zal waarschijnlijk ook struikelen).

Dit struikelblok ga je dan toch meteen verhelpen? Of doe je dan toch nog eerst een gecontroleerde A/B-test (A/B-test met de bestaande pagina, waar dus blijkbaar iedereen over valt, tegenover een variatiepagina)?

Ik ben het helemaal eens met het ‘you should test that’-principe, maar ik vraag mij af of het in dit geval nodig is. Het lijkt mij alleen nodig wanneer je het probleem op verschillende manieren kunt oplossen en je graag wilt weten welke oplossing het beste gaat werken. Maar als er bijvoorbeeld een button is en men klikt er de hele tijd naast, dan weet je gewoon dat deze button irritant klein is en maak je ‘m groter.

Wat vind jij? Hoe pak je dit aan? Laat het weten in de reacties.